Ex-empleado de OpenAI habla sobre la AGI, la superinteligencia y la dinámica de poder global

En un episodio reciente del podcast Dwarkesh Patel, el ex-empleado de OpenAI, Leopold Ashenbrenner, miembro del ahora disuelto equipo de superalineación, brindó una visión cautivadora y perspicaz del mundo de la AI avanzada, su trayectoria potencial y sus implicaciones para la humanidad.

Analizando las ideas de Ashenbrenner:

Ashenbrenner, conocido por su profundo conocimiento de la AI, articuló con elocuencia sus puntos de vista sobre una variedad de temas, que incluyen:

- El estado actual de la AGI: Habló sobre las capacidades de

GPT-4y si representa la "chispa" de la Inteligencia Artificial General, como sugieren algunos expertos. También exploró la línea de tiempo potencial desde laAGIhasta la superinteligencia, cuestionando si sería una evolución gradual o una explosión rápida. - Más allá de los apocalípticos y utópicos de la

AI: Ashenbrenner desafía la dicotomía simplista de los apocalípticos de laAI(que abogan por un alto total en el desarrollo de laAI) y los utópicos (que visualizan un futuro idílico impulsado por laAI). Él enfatiza la necesidad de considerar un espectro más amplio de posibilidades y consecuencias potenciales. - La geopolítica de la superinteligencia: Una preocupación clave planteada fue el potencial de la

AIpara perturbar el equilibrio de poder global. Ashenbrenner argumenta que naciones como China ven la supremacía de laAIcomo crucial para sus intereses nacionales. Advierte sobre una posible carrera armamentista deAI, con consecuencias devastadoras si una nación obtiene una ventaja decisiva. - La importancia de "desatar" la

AI: Usó el término "desatar" para describir el proceso de desbloquear todo el potencial de los sistemas deAI. Esto implica ir más allá del simple pre-entrenamiento en conjuntos de datos masivos y desarrollar técnicas para que laAIaprenda y se adapte de forma autónoma, similar aAlphaGoyAlphaStarde DeepMind. - La

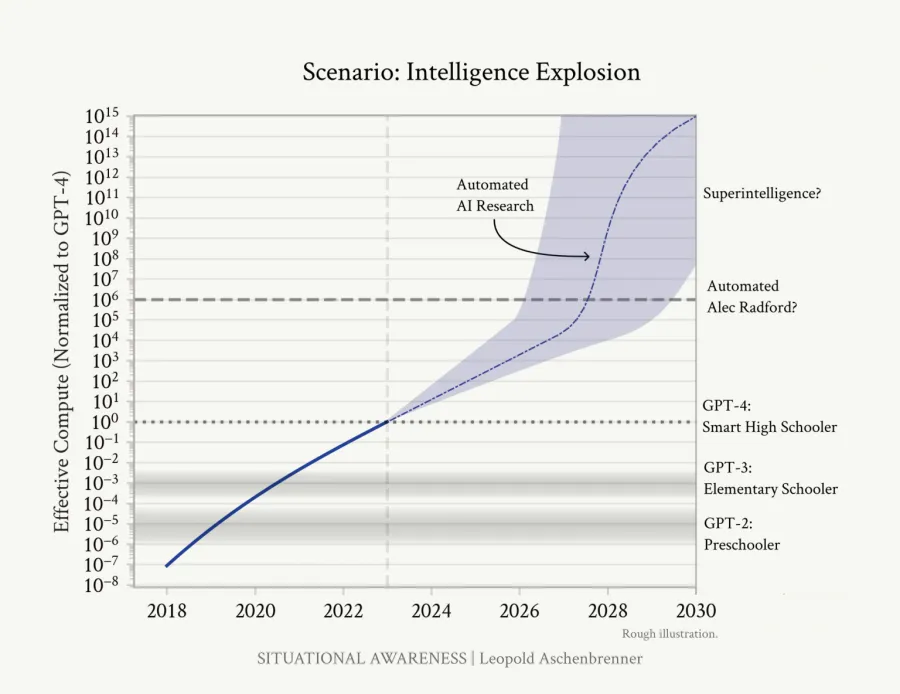

AIcomo catalizador del rápido avance tecnológico: Ashenbrenner sugiere que laAIpodría acelerar significativamente el progreso tecnológico, comprimiendo potencialmente décadas de innovación en unos pocos años. Esto podría conducir a una "explosión de inteligencia", con profundas implicaciones para varios campos, incluyendo la robótica y las aplicaciones militares. - El potencial de las dictaduras impulsadas por la

AI: Una de las posibilidades más escalofriantes discutidas fue el potencial de laAIpara empoderar a los regímenes autoritarios. Ashenbrenner pinta una imagen de vigilancia, censura y represión habilitadas por laAI, lo que sugiere que la superinteligencia podría consolidar el control de las dictaduras en las próximas generaciones.

Conclusiones y reflexiones clave:

La entrevista de Ashenbrenner sirve como un duro recordatorio de que el desarrollo de la AI avanzada no es simplemente un esfuerzo tecnológico sino también profundamente político y social. Algunas conclusiones clave incluyen:

- La necesidad de matices y una consideración amplia: Es crucial ir más allá de las narrativas simplistas de fatalidad o utopía de la

AI. Debemos participar en discusiones matizadas sobre los beneficios y riesgos potenciales de laAI, explorando una gama más amplia de futuros posibles. - La urgencia de la cooperación internacional: Para mitigar los riesgos de una carrera armamentista de

AIy garantizar que el desarrollo de laAIbeneficie a toda la humanidad, la cooperación internacional es primordial. Esto incluye establecer pautas éticas, fomentar la transparencia y promover la investigación y el despliegue responsable de laAI. - La importancia de la preparación social: A medida que la

AItransforma rápidamente nuestro mundo, es esencial prepararse para su impacto social. Esto incluye abordar el posible desplazamiento laboral, garantizar un acceso equitativo a los beneficios de laAIy protegerse contra la discriminación y el sesgo impulsados por laAI.

Las ideas de Ashenbrenner ofrecen una perspectiva aleccionadora pero que invita a la reflexión sobre el futuro de la AI y su impacto potencial en la humanidad. Es un llamado a la acción para que investigadores, legisladores y ciudadanos por igual participen en un diálogo informado y proactivo para dar forma a la trayectoria del desarrollo de la AI y garantizar un futuro donde esta poderosa tecnología sirva como una fuerza para el bien.

Paper completo:

Entrevista completa original:

- Register with Email

- Login with LinkedIn

- Login with GitHub